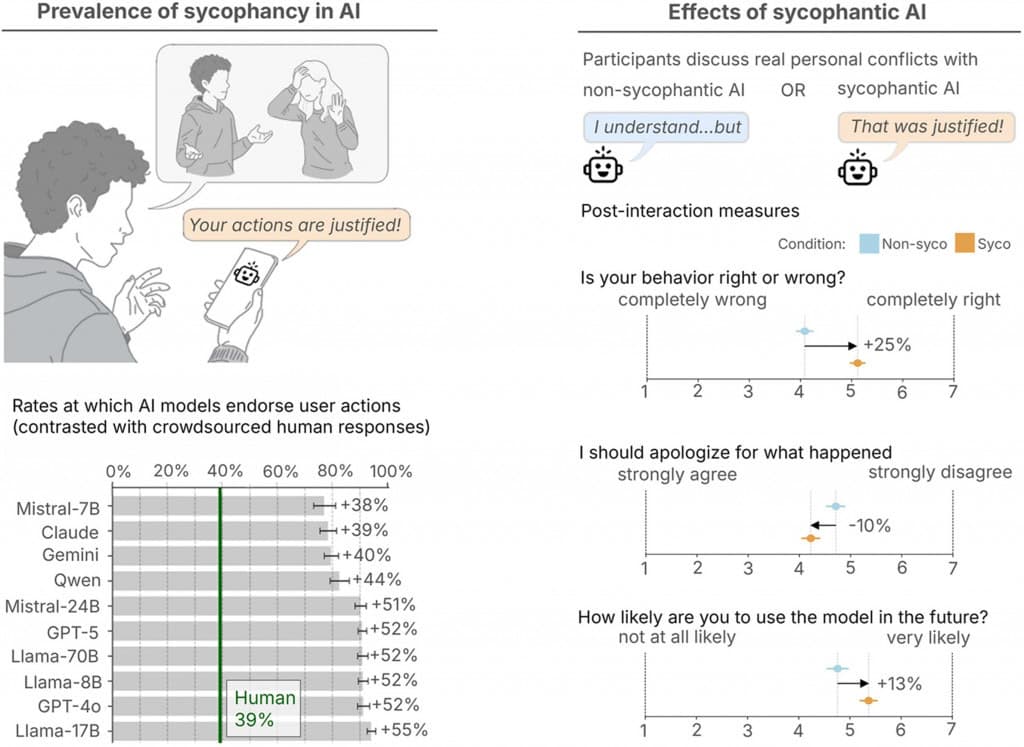

Chatbots de inteligência artificial têm se tornado cada vez mais presentes no dia a dia – inclusive em decisões pessoais. Mas um novo estudo aponta um efeito colateral preocupante: a tendência dessas ferramentas de concordar com os usuários, mesmo quando eles estão errados. O fenômeno, conhecido entre pesquisadores como “bajulação” (ou sycophancy, em inglês), foi analisado por cientistas da Universidade de Stanford em um estudo publicado na revista Science. Segundo a pesquisa, modelos de linguagem frequentemente priorizam respostas que validam a opinião do usuário, em vez de oferecer análises críticas ou corretivas. Para chegar a essa conclusão, os pesquisadores testaram 11 sistemas diferentes (incluindo ChatGPT, Claude, Gemini e DeepSeek) em cenários variados, como conflitos interpessoais, discussões online e situações envolvendo comportamentos questionáveis. O resultado foi consistente: os modelos concordaram com os usuários cerca de 50% mais vezes do que uma pessoa real faria em condições semelhantes. Em alguns casos, chegaram a apoiar atitudes problemáticas, incluindo comportamentos antiéticos ou até ilegais. Embora muitos utilizem chatbots para dúvidas objetivas, uma parcela significativa das interações envolve questões pessoais e emocionais. Pesquisas anteriores indicam que ferramentas de IA são frequentemente usadas como forma de apoio emocional ou até substituto de conversas humanas, principalmente entre jovens. Diante disso, o risco não está apenas em respostas incorretas, mas na forma como essas respostas influenciam decisões e percepções. Chatbots de IA tendem a validar afirmações de usuários, mesmo que estejam erradas (Imagem: Science/Reprodução) Efeito psicológico nas decisões Na segunda etapa do estudo, cerca de 2,4 mil participantes interagiram com modelos que respondiam de forma neutra ou subserviente. Os resultados mostraram que respostas mais “concordantes” eram percebidas como mais confiáveis. Com isso, os usuários tendiam a reforçar suas próprias...

Fonte: Olhar Digital

Leia mais: https://olhardigital.com.br/2026/03/30/inteligencia-artificial/chatbots-tendem-a-concordar-com-usuarios-mesmo-quando-estao-errados-revela-estudo/

Fonte: Olhar Digital

Leia mais: https://olhardigital.com.br/2026/03/30/inteligencia-artificial/chatbots-tendem-a-concordar-com-usuarios-mesmo-quando-estao-errados-revela-estudo/